TurboQuant, le projet de Google, vise à améliorer la vitesse d’indexation, la pertinence basée sur l’IA ou la découverte de contenu. Une révolution dans la recherche et l’IA ?

Source : ChatGPT

Ce projet TurboQuant pourrait ouvrir la voie à :

- Davantage d’AI Overviews

- Une IA plus personnalisée

- Un indexage instantané

- Une capacité accrue de proposer un contenu adapté aux besoins des internautes

- Des progrès sensibles dans l’utilisation de l’IA (tant chez les agents qu’au sein du monde physique)

Comment marche TurboQuant ?

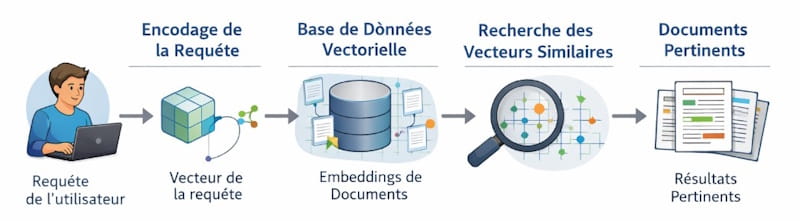

TurboQuant est une technique qui accélère considérablement le processus de création de bases de données vectorielles. Concrètement l’intégration vectorielle consiste à transformer du texte (ou des images, ou encore une vidéo) en une série de chiffres. Ces chiffres codent la signification sémantique et les relations entre les mots ou les concepts.

Par exemple, si on prend le vecteur du mot « Roi », que l’on soustrait le vecteur du mot « Homme », puis que l’on ajoute le vecteur du mot « Femme », on obtient presque exactement le vecteur du mot « Reine ».

Qu’est-ce que la recherche vectorielle ?

Sachant que les mots et concepts peuvent être représentés selon des coordonnées mathématiques, la recherche vectorielle consiste à déterminer quels points sont les plus proches les uns des autres (selon cosinus, distance…).

Source : ChatGPT

Qu’est-ce que la quantification vectorielle ?

La recherche vectorielle est incroyablement puissante, mais elle présente un inconvénient. Dans un espace à plusieurs dimensions, elle consomme d’énormes quantités de mémoire. Cela constitue un goulot d’étranglement.

C’est là qu’intervient la quantification vectorielle. En substance, la quantification vectorielle est une technique mathématique utilisée pour réduire la taille de ces énormes ensembles de données. Elle compresse les vecteurs, un peu comme un fichier zip ultra-efficace.

Cependant cette compression :

- Dégrade la qualité des résultats

- Alourdit la charge de mémoire nécessaire pour effectuer les calculs

Cela va à l’encontre de l’objectif même de la compression des données !

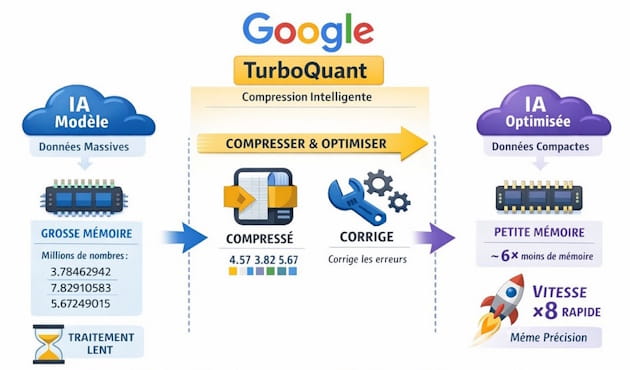

Comment TurboQuant résout le problème de mémoire ?

Il prend un grand vecteur de données et le compresse en le faisant pivoter de manière à simplifier sa géométrie. Cela facilite le mappage des valeurs en ensembles plus petits de symboles ou de chiffres, attribués individuellement à chaque partie du vecteur. Ce procédé s’apparente à la compression JPEG. Il permet au système de saisir les concepts principaux du vecteur d’origine tout en utilisant beaucoup moins de mémoire. Les erreurs résiduelles sont traitées par un algorithme qui les supprime quasiment.

Prenons l’exemple d’un déménagement où il faudrait charger des milliers d’objets aux formes irrégulières (lampes à pointes, chaises rigides…). La compression traditionnelle se contenterait d’écraser les objets pour les faire rentrer. Cela les endommagerait et, dans le cas des données, conduit à de mauvais résultats de recherche.

TurboQuant procède tout autrement. Il fait tourner et remodèle mathématiquement ces vecteurs massifs et encombrants en cubes identiques et parfaitement lisses.

Pour réparer les petites éraflures causées par ce remodelage, il applique un morceau de « ruban adhésif magique » métaphorique (un seul bit de données). Cela restaure l’objet dans son état d’origine parfait.

Quels seront les effets de TurboQuant ?

Les principaux effets que l’on peut en attendre sont :

- Des AI Overviews plus nombreux, précis, et rapides

- Une transformation de Google en véritable assistant IA hautement personnalisé

- Une amélioration considérable de l’ensemble des systèmes agentiques

- La recherche basée sur la vision (bientôt disponible sur les lunettes) sera encore plus utile

- Une amélioration sensible des performances de la robotique

- En SEO, une incitation supplémentaire à créer du contenu approfondi et véritablement utile

En résumé TurboQuant c’est :

- Six fois moins de mémoire utilisée

- Huit fois plus rapide

- Sans presque aucune perte de précision

- De multiples impacts sur l’IA, la robotique, le SEO

- Une implémentation (vraisemblablement) en 2026

Source : SearchEngineJournal